Sigma ha acquisito il 100% delle azioni di Foveon, azienda statunitense che sviluppa i sensori impiegati dal produttore di fotocamere nipponico nelle sue reflex e compatte, tra cui le ultime uscite SD15 e DP2.

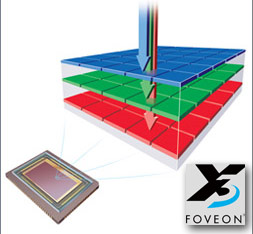

Le due aziende hanno collaborato per diversi anni per lo sviluppo di sensori e dalla partnership è nato il ben noto Foveon X3, elemento sensibile a tre strati, che permette di superare alla base problemi quali gli artefatti dell'algoritmo di demosaicing, offrendo inoltre una nitidezza maggiore.

Dopo l'acquisizione Foveon continuerà a portare avanti lo sviluppo degli elementi sensibili nel suo stabilimento di San Jose, ma in più stretta collaborazione con Sigma, in direzione di una maggiore integrazione tra il sensore e le fotocamere e le ottiche del produttore giapponese. Inoltre non è escluso che la partnership possa mettere in cantiere progetti in merito a nuovi tipi o formati di sensori.