|

Guida alla fotografia - parte 5: lenti, sensori, fattori di moltiplicazione

Matteo Cervo - 27 Novembre 2007

“Ultima puntata del primo ciclo di guide alla fotografia. Torniamo a considerare la struttura delle fotocamere e ci addentriamo ad analizzare le ottiche e i sensori. Chiariremo, riguardo questi ultimi, concetti come il fattore di moltiplicazione e il formato. Prese in esame anche le principali aberrazioni delle ottiche.”

|

|

Eccoci arrivati all'ultima puntata del primo ciclo di guide fotografiche. Negli scorsi appuntamenti abbiamo affrontato diversi temi, pensati come introduzione al mondo della fotografia digitale. A questi indirizzi potete trovare la puntata introduttiva, quella relativa all'inquadratura, quella dedicata all'esposizione e, infine, l'articolo sulla profondità di campo e gli istogrammi. Nei prossimi cicli entreremo più nel dettaglio di concetti come la temperatura colore della luce, l'utilizzo del flash, le riprese notturne, la fotografia di cerimonia, il workflow di postproduzione, e via dicendo.

Oggi, utilizzando il percorso che la luce compie dallobiettivo al sensore, si cercherà di fare chiarezza sui principali elementi che concorrono alla creazione dellimmagine nella fotocamera: problematiche delle lenti, tipologie di sensori e rapporti di moltiplicazione, elaborazione dei dati e conversione degli stessi. Come accennato nella prima guida, la luce arriva alla lente frontale dell'obiettivo praticamente con infiniti angoli di incidenza. Parte di questa luce viene persa per fenomeni di riflessione e rifrazione e buona parte, quasi la totalità se l'obiettivo è di buona fattura, entra nel corpo dello stesso, il barilotto. La lente frontale non è l'unica presente all'interno dell'obiettivo, infatti sono diverse le lenti raccolte in gruppi che permettono di ovviare alle aberrazioni indotte dalla prima lente e consentendo la costruzione di obiettivi di dimensioni contenute anche se di elevata lunghezza focale.

Le aberrazioni sono gli errori indotti nel percorso della luce da parte della lente per via dei fenomeni di rifrazione: la rifrazione è la capacità che ha un corpo attraversato dalla luce, in generale da qualsiasi onda elettromagnetica, di deviarne la direzione. Nel nostro caso il corpo è la lente ma pensate che anche strati d'aria a temperatura e percentuale d'umidità differenti possiedono indici di rifrazione differenti. La luce che colpisce la lente frontale dovrebbe raggiungere il sensore senza evidenti modificazioni, in realtà questo non succede a causa delle deformazioni geometriche e cromatiche.

Per semplicità si utilizzino tre lunghezze d'onda relative ai colori Rosso, Verde, Blu: i raggi paralleli tra loro che colpiscono la lente frontale, nellattraversarla vengono deviati con angoli diversi; questo accade perché ogni componente colore possiede una specifica lunghezza donda che subisce una rifrazione di un determinato indice e di conseguenza, angolo.

Aberrazione cromatica

A livello fotografico tutto questo si traduce in soggetti dai bordi confusi; se sugli stessi bordi predomina una componente colore, in gergo si dice che la foto è affetta da color fringing. Lo stesso fenomeno è forse più noto con il nome di purple fringing poiché la componente rossa è più visibile e viene maggiormente accentuata dal rapporto di ingrandimento dellobiettivo; nella pratica la causa che lo genera non è solamente la scarsa qualità dellobiettivo, ma per determinati sensori, anche la presenza di microlenti sulla superficie degli stessi. Di conseguenza anche usando obiettivi di ottima fattura non si elimina del tutto la possibilità di incappare nel purple fringing anche perché il software della fotocamera fa la sua parte e può reagire in maniera diversa addirittura in scatti consecutivi.

Il color fringing è unaberrazione cromatica, poiché funzione del colore ovvero lunghezza donda; può essere ridotto utilizzando gruppi di lenti poste a valle della lente frontale che compensino, attraverso i propri indici di rifrazione, la deflessione dovuta dalla prima lente. Si dice che lobiettivo è composto da lenti acromatiche o da coppiette-triplette apocromatiche. Un altro sistema è quello di costruire lenti con materiali a bassissima dispersione come la fluorite, ma obiettivi di questo tipo sono estremamente costosi.

Compensazione dell'aberazione cromatica

Le aberrazioni geometriche sono di diversi tipi, prima fra tutte si potrebbe citare laberrazione sferica. Come tutti avrete potuto osservare, le lenti degli obbiettivi sono di tipo convesso e riproducono quindi una porzione di superficie sferica; tuttavia la sfera non è la forma ideale per costruire una lente anche se a livello tecnologico risulta più semplice. Proprio questa forma induce un'aberrazione geometrica che causa una distorsione dell'immagine sul piano focale; la soluzione è utilizzare delle lenti asferiche che risolvono proprio questo problema. Un'altra soluzione è costruire la lente in maniera ottimale al suo scopo, ma qui si dovrebbe aprire una parentesi sulla qualità degli obiettivi fissi e degli zoom scatenando un acceso dibattito. Affronteremo l'argomento in altra sede.

Aberrazione sferica

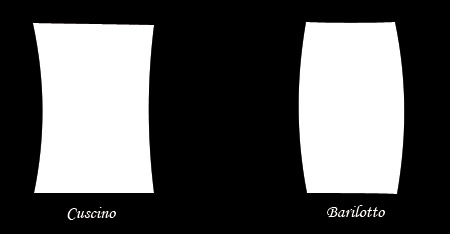

Nella guida sull'inquadratura si è parlato delle difficoltà nel riprendere i soggetti architettonici senza deformarli; questo è dovuto alla curvatura di campo legata ad un fenomeno chiamato astigmatismo dei fasci obliqui. Il problema nasce dal fatto che la porzione d'immagine che si trova fuori dall'asse dell'obiettivo/lente viene riportata sul piano focale come se fosse curvo. Tutti gli obiettivi ora prodotti sono anastigmatici, ma così come le altre aberrazioni è un fenomeno che può essere ridotto ma non eliminato completamente. Le due principali deformazioni che si osservano sono quelle dette a barilotto e a cuscino: negli obiettivi zoom la prima la si osserva soprattutto alla minima lunghezza focale mentre la seconda alla massima.

Sempre legato all'astigmatismo dei fasci obliqui, anche se in maniera diversa, è il fenomeno della vignettatura, che spesso deve la sua causa a ragioni più banali come la presenza di filtri montati in serie davanti all'obiettivo, o a paraluce non espressamente dedicati alla specifica ottica. La luce ai bordi della lente finale, e quindi del fotogramma, arriva in misura minore rispetto al resto dell'ottica e causa quel bordo scuro, la vignettatura appunto, che può essere eliminata in fase di postproduzione. Schemi ottici semplici soffrono meno la caduta di luce al bordo, che è sempre presente in maniera più o meno accentuata negli zoom tuttofare.

Quanto esposto nella pagina precedente consente di comprendere quali siano le caratteristiche che descrivono un'ottica di buona qualità, senza per altro parlare di contrasto e nitidezza, altri due parametri molto importanti e che cambiano realmente volto ad una foto. Per le compatte e le bridge che non hanno la possibilità di intercambiare lottica, la scelta di una fotocamera piuttosto che un'altra sarà dettata, a pari condizioni, proprio dalla qualità delle ottiche; per quanto riguarda le reflex è bene ricordare che un buon corredo di qualità dura nel tempo e restituisce risultati veramente soddisfacenti.

Se state ponderando lacquisto dellultimo modello di fotocamera, forse è il caso di chiedervi se sarebbe meglio investire in ottiche il budget che avete stanziato per soddisfare il vostro piccolo desiderio. Un parco ottiche completo e di qualità costa molto più del singolo corpo macchina, di conseguenza è bene riflettere sul tipo di sistema che vorrete adottare poiché ogni casa produttrice ha i propri innesti e vincola quindi la scelta.

Per chi si chiede quando un parco ottico è completo, la risposta è funzione del genere di fotografie che fate e della sensibilità che avete. La fotografia, infatti, spazia tra una vasto numero di generi: ritratto, interni, macro, still life, reportage, cerimonia, sport, caccia fotografica, paesaggio, architettura, oltre a una serie di sottogeneri e correnti più o meno creativi e difficili da codificare. Ottiche con determinate lunghezze focali risultano più congeniali per un determinato genere di foto ma nessuno vi obbliga a fare ritratti esclusivamente con medio tele oppure paesaggi con un grandangolo! Sebbene la forte espansione degli obiettivi zoom consenta di viaggiare più leggeri con un'ottica tuttofare è utile avere ben chiare in mente una serie di indicazioni di massima. da fotografia classica insegna che sono sufficienti tre tipi di ottiche al fotografo medio:

| Grandangolo | ≤ 35mm equivalente |

Elevato angolo di campo |

|---|---|---|

| Normale | 50mm equivalente |

Angolo di campo simile alla visione umana |

| Medio Tele/Tele | ≥ 70mm equivalente |

Piccolo angolo di campo |

Il termine equivalente vuole indicare che le lunghezze focali sono riferite al formato leica 35mm, si analizzeranno in seguito i rapporti di ingrandimento dovuti alle dimensioni dei sensori.

Il grandangolo, grazie allelevato angolo di campo permette di racchiudere nellinquadratura molto spazio ed è utile quando si fotografa in interni dove cè poco spazio di movimento. Tali obiettivi spesso sono caratterizzati da una distanza di messa a fuoco molto più piccola dei fratelli di lunghezza focale superiore e soprattutto allungano i piani immagine dividendoli tra loro ed amplificando leffetto profondità.

Lobiettivo normale, o il cinquanta, viene chiamato così perché la sua focale è quella che si avvicina maggiormente alla diagonale del formato 35mm permettendo un trasferimento dellimmagine dalla lente al sensore/pellicola ottimale, in scala 1:1 e quindi senza rapporti di ingrandimento o riduzione. Una caratteristica fondamentale dell'obiettivo con focale di 50mm è l'ampiezza dell'angolo di campo, che si avvicina ai 46° dell'occhio umano.

Il medio tele/tele è un obbiettivo molto utile nei ritratti poiché permette di avvicinare il soggetto con un ottima resa dello sfuocato e, al contrario del grandangolo, opera una sorta di compressione dei piani immagine riducendo leffetto profondità al crescere della focale. In generale lutilizzo dei teleobiettivi è utile ogni qual volta vi sia la necessità di riprendere soggetti molto lontani: grazie allingrandimento dovuto allottica il soggetto verrà visto come se fosse più vicino e, in ultima analisi, risulterà ingrandito.

Allinterno del barilotto, poco prima della lente posteriore, si trova il diaframma: si è già spiegato che il suo ruolo è quello di rubinetto per la luce, è formato da diverse lamelle parzialmente sovrapposte che chiudendosi ad iride riducono o aumentano la superficie circolare attraversata dalla luce. Non tutti gli obiettivi hanno lo stesso numero di lamelle a costituire il diaframma, alcuni ne hanno sette, altri nove, altri ancora tredici; maggiore è il numero di lamelle, migliore sarà lapprossimazione della forma del foro equivalente ad un cerchio.

Simulazione di un diaframma a numero di lamelle crescente

Questo si traduce in uno sfocato più morbido e graduale, e a minori artefatti luminosi dovuti ai più ampi angoli di incontro delle lamelle. La difficoltà nel costruire obiettivi con un elevato numero di lamelle fa lievitare il prezzo di questi ultimi che vengono spesso usati appositamente per la fotografia di ritratto.

Superata lultima lente posteriore dellobiettivo la luce può seguire due strade: riversarsi direttamente sul sensore, come succede nelle compatte e nelle bridge oppure venire riflessa dallo specchio verso il pentaprisma per riprodurre limmagine a livello del mirino, come succede nelle reflex. Anche in queste ultime, alla fine, dopo linnalzamento dello specchio e lapertura delle tendine dellotturatore, la luce arriva direttamente al sensore.

In prima approssimazione il sensore ha lo stesso compito di coni e bastoncelli presenti nel nostro occhio: è un trasduttore che rileva la quantità di fotoni che lo colpiscono e genera un segnale elettrico di una determinata intensità; oltre a questo, il sensore opera una lettura delle componenti cromatiche del fascio luminoso in modo tale da restituire correttamente i diversi colori.

Più nel dettaglio, quanto spiegato sopra è possibile grazie ad elementi denominati fotodiodi, che ricoprono quasi interamente la superficie del sensore. I fotodiodi sono caratterizzati da dimensioni complessive di una decina di micron circa: in questo spazio, oltre alla parte "attiva" del fotodiodo è compresa anche una porzione di elettronica che non partecipa al processo di trasduzione. Lo spazio occupato da questa elettronica è denominato "fattore di riempimento". Si può intuire come il fattore di riempimento sia un limite nellacquisizione dellimmagine proprio della tecnica digitale. La pellicola, infatti, essendo una soluzione chimica continua non presenta questo tipo di problema.

Affinché la resa dinamica a livello fotografico risulti ottimale, sarebbe opportuno utilizzare fotodiodi con una ampia (sempre nell'ordine dei micrometri) superficie sensibile in modo tale che ogni singolo fotodiodo possa raccogliere un maggior numero di informazioni (fotoni). All'atto di progettazione e costruzione di una fotocamera digitale ultracompatta, dove lo spazio disponibile è ridotto, sarà quindi necessario operare una scelta di compromesso a parità di dimensione del sensore: scegliere un numero minore di fotodiodi ad ampia superficie oppure, viceversa, scegliere fotodiodi con superificie ridotta in modo tale da poterne adottare in numero maggiore.

Tra il numero di fotodiodi presenti in un sensore e il numero di pixel che la macchina fotografica è in grado di produrre, non esiste alcuna sorta di correlazione diretta. In taluni casi un sensore è costituito da un numero inferiore di fotodiodi rispetto al numero di pixel con cui viene prodotta l'immagine: in questo caso le informazioni sono interpolate direttamente dal software della macchina fotografica. In altri casi, invece, accade che il numero di fotodiodi sia maggiore rispetto ai pixel dell'immagine: in questo caso alcuni fotodiodi sono destinati ad altri usi (come ad esempio analisi esposimetrica e di bilanciamento del bianco).

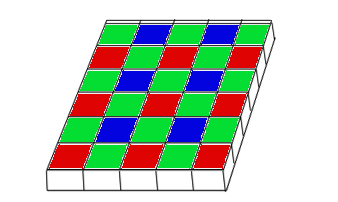

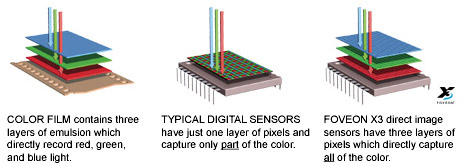

A livello concettuale si può pensare al sensore come ad una cassettiera senza cassetti sdraiata sul pavimento dove ogni vano rappresenta un fotodiodo e raccoglie i fotoni che vi cascano dentro. In un modello di questo tipo, tuttavia, non è possibile risalire ad alcuna informazione relativa al colore, dal momento che l'unica cosa che può essere misurata è la quantità di luce presente in ogni "vano". Al fine di ricostruire le informazioni cromatiche viene sovrapposta alla cassettiera una scacchiera colorata i cui quadri sono rosso, blu e verde.

La scacchiera, chiamata filtro di Bayer, è una pellicola semitrasparente che permette ad una sola componente colore di raggiungere il fotodiodo e di conseguenza il singolo fotodiodo potrà leggere lintensità luminosa di un solo colore primario. Lintero spettro colore viene così ricostruito a posteriori via software facendo una stima sulla base dei fotodiodi adiacenti a quello considerato. I sensori che adottano questo sistema prendono il nome di sensori di bayer e rappresentano la stragrande maggioranza dei sensori presenti sul mercato.

Ogni pixel immagine è il risultato dellinterpolazione di almeno tre fotodiodi, uno per ogni colore primario. Tempo fa Sony ha progettato una variante del filtro di bayer sostituendo ad uno dei filtri verdi il colore Smeraldo Emerald, lo spazio colore che ne deriva passa da RGB ad RGBE.

Il motivo per il quale il 50% dei fotodiodi codifica per il verde mentre solo il 25% rispettivamente per il rosso e per il blu, deriva dal fatto che anche il nostro sistema visivo è in grado di distinguere un maggior numero di sfumature del verde piuttosto che degli altri colori.

I sensori chiamati Foveon si basano invece sul principio del film fotografico, grazie alla differente capacità di penetrazione delle frequenze: ogni fotodiodo è costruito a strati e può leggere tutte le componenti colore. Si può quindi avere un sensore con 12 milioni di fotodiodi, dispositi su tre strati da 4 milioni l'uno. L'immagine finale viene poi effettivamente formata, per interpolazione, da 12 megapixel, anche se a rigor di logica questa è divisa in realtà (guardando il sensore frontalmente) da una griglia di 4 megapixel.

I sensori si dividono in due grandi famiglie a seconda della tecnologia di produzione, i CCD (Charge Couplet Device) e gli APS (Active Pixel Sensor). Ai sistemi APS appartengono sensori che fanno uso di tecnologie CMOS o LBCAST JFET. La differenza di tecnologia tra CCD e APS porta anche a diversi modi di trasportare il segnale elettrico generato dai fotoni che colpiscono l'area sensibile. Quest'ultimo fatto è responsabile inoltre delle differenti caratteristiche dei due tipi di sensore.

I sensori CMOS hanno in generale alcuni vantaggi, tra cui un minor consumo energetico, dato anche dalla possibilità di integrare sullo stesso chip la circuiteria sia digitale sia analogica. Fino a qualche tempo fa i sensori CMOS erano destinati alle fotocamere più economiche (ad esempio equipaggiano tuttora la totalità dei telefonini), mentre i sensori CCD hanno visto un largo impiego su reflex e compatte. Eccezione fa Canon che ha sempre puntato, anche per i suoi prodotti di fascia alta, sui sensori basati su tecnologia CMOS. La tecnologia LBCAST JFET è stata invece lanciata dal produttore nipponico Nikon.

Quanto esposto nella pagina precedente permette di capire le motivazioni in base a cui possano esistere sensori aventi lo stesso numero di Mpx ma che presentano dimensioni fisiche differenti. Di solito i sensori di piccole dimensioni sono equipaggiati con fotodiodi anch'essi piccoli e questa circostanza va a scapito della qualità e della definizione d'immagine. Per contro, sensori aventi dimensioni fisiche maggiori utilizzano fotodiodi grandi, a tutto vantaggio della definizione e della gamma colore.

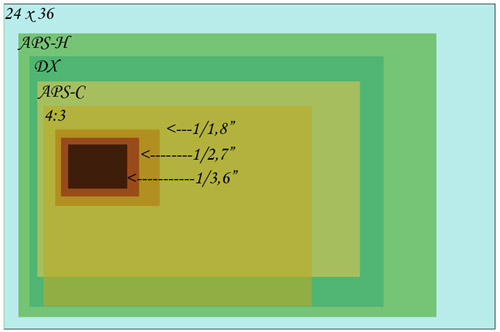

I formati di sensore più comuni presenti sul mercato vengono tutti comparati con la dimensione detta Full Frame del formato 3mm. Questo riferimento misura 36x24mm per lato. Facendo il rapporto del lato lungo sul lato corto si ottiene una frazione che esprime appunto le proporzioni dellimmagine e caratterizza il formato: nel caso del 35mm appena citato si ottiene: 36/24=1,5 cioè 3/2. La tabella seguente mostra la tipologia di formato dei più diffusi sensori.

Tipo Sensore |

Larghezza |

Altezza |

Formato |

|---|---|---|---|

| 1/3,6 | 4mm |

3mm |

4/3 |

| 1/3,2 | 4,536mm |

3,416mm |

4/3 |

| 1/3 | 4,8mm |

3,6mm |

4/3 |

| 1/2,7" | 5,371mm |

4,035mm |

4/3 |

| 1/2,5" | 5,76mm |

4,29mm |

4/3 |

| 1/2" | 6,4mm |

4,8mm |

4/3 |

| 1/8" | 7,167mm |

5,319mm |

4/3 |

| 1/1,7" | 7,6mm |

5,7mm |

4/3 |

| 2/3 | 8,8mm |

6,6mm |

4/3 |

| 1" | 12,8mm |

9,6mm |

4/3 |

| 4/3" | 18mm |

13,5mm |

4/3 |

| Canon APS-C | 22,2mm |

14,8mm |

3/2 |

| Nikon DX - Sony APS-C | 23,7mm |

15,7mm |

3/2 |

| Canon APS-H | 28,7mm |

19,1mm |

3/2 |

| 35mm Film / Full Frame | 36mm |

24mm |

3/2 |

A livello grafico si possono meglio comprendere le differenze tra principali tipi:

Lo scarto più grande lo si osserva proprio tra i sensori nei formati 4:3, APS e DX, adottati dalle reflex, rispetto a quelli in dotazione alle compatte. In questo caso, parlando di formati, l'acronimo APS si riferisce al formato Advanced Photo System, un sistema fotografico proposto qualche anno fa basato su pellicole di formato inferiore al classico 35mm.

Gli utenti che effettuano il passaggio da reflex analogica a digitale, a meno di comprare modelli professionali di punta delle diverse case, devono tenere in considerazione il rapporto di moltiplicazione da applicare alle lenti. Vediamo ora di circostanziare meglio questo dettaglio. Lo standard è sempre stato il formato 35mm e di conseguenza le ottiche erano studiate appositamente per esso. Con lavvento dei sensori digitali, più piccoli della pellicola, le ottiche non sfruttano tutto il campo visivo che potrebbero. Si ottiene così laumento apparente della lunghezza focale dellobiettivo che fa felici fotografi sportivi e naturalisti.

In realtà la lunghezza focale rimane la stessa ma cambia la dimensione del campo di vista, usiamo un esempio grafico:

Il rettangolo opaco rappresenta larea coperta da un sensore APS-C rispetto quella full frame: la diagonale di questultimo è più grande di circa 1,5 volte e, di conseguenza, il camoscio ripreso con 400mm risulta ingrandito sul sensore APS, proprio come se fosse stato ripreso da un tele di 400x1,5=600mm. In realtà la lunghezza focale non cambia e lobiettivo è esattamente lo stesso. Questo aspetto positivo nasconde il cosiddetto retro della medaglia, infatti, diventa problematico procurarsi un grandangolo spinto. Chi si era affezionato alla focale da 20mm nella ripresa dei paesaggi si trova ora a disposizione un grandangolo equivalente di 30-40mm e per ottenere il risultato del pieno formato bisogna portarsi su ottiche come 12 o 14mm il cui costo è sensibilmente maggiore. La situazione si complica per ottenere ottiche equivalenti al 35mm: in questa condizione si dovrebbero utilizzare obiettivi con focale da 7mm.

Nel momento in cui si preme il pulsante di scatto, le informazioni luminose trasdotte dai fotodiodi viaggiano alle unità di elaborazione delle fotocamere alle quali spetta uno dei compiti più importanti. Stiamo parlando infatti del generare limmagine combinando tra loro le informazioni di intensità luminosa e colore, operazione che si vorrebbe venisse fatta con il maggior dettaglio possibile ed il minimo rumore. Migliore è lalgoritmo adottato dalla fotocamera, migliori saranno i risultati a parità di elettronica, anche se in fin dei conti la qualità informativa iniziale è uno sbarramento che fa la differenza.

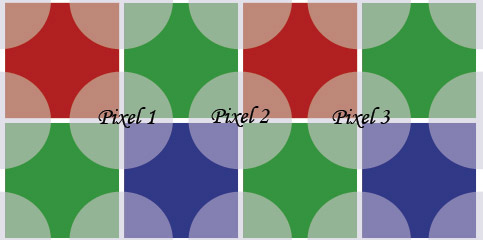

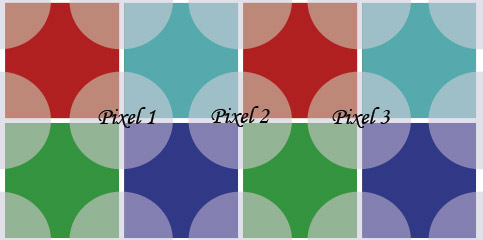

I sensori bayer sono quelli in cui lalgoritmo di elaborazione gioca un ruolo fondamentale, prima ragione fra tutte è il fatto che le informazioni trasdotte sono povere, nel senso che ogni fotodiodo porta una sola componente colore che non rappresenta il colore reale di quella porzioncina di immagine. Lintensità luminosa del colore primario ricevuto viene interpolata con almeno quella di altri due fotodiodi adiacenti. Cosa succederebbe se proprio in quella porzione di fotogramma venisse rappresentato uno sfondo monocromatico attraversato da una sottile linea di colore differente? Se sfortunatamente le informazioni colore della linea non venissero lette da alcun fotodiodo che codifica si avrebbe per quel colore? Si otterrebbe solamente lo sfondo monocromatico perdendo informazioni immagine.

Per evitare questo problema una ipotesi fondamentale dellalgoritmo di elaborazione è che linformazione spaziale non sia povera. Questo non può essere sempre assicurato e di conseguenza si pone un filtro antialiasing di fronte al sensore che spalma le informazioni colore parzialmente anche sui fotodiodi adiacenti in maniera da ottenere una ridondanza di informazioni; questa operazione sfuoca limmagine, come quando una goccia dacqua bagna linchiostro trasformando un punto definito in una macchiolina. Così facendo ci si assicura di non perdere informazioni ma fatto questo, riaffiora lobiettivo nitidezza; lalgoritmo di elaborazione, nel suo complesso detto di demosaicing, deve essere in grado di ricostruire limmagine con il maggior numero di dettagli e a valle di quanto detto precedentemente questa operazione diventa molto complessa. Migliore lalgoritmo, migliore il risultato finale. Se lalgoritmo non risulta così efficiente quello che si ottiene è lodiato effetto Moiré, la desaturazione dei colori o laliasing dei colori con la comparsa di verdi, rossi o blu fantasma, i cosiddetti artefatti jpeg. Sotto questo punto di vista i sensori Foveon hanno una vita più facile poiché la necessità di interpolare le informazioni colore è minore.

Abbiamo parlato di artefatti jpeg, ma molte fotocamere non possono anche registrare in formato Raw? Sì, ed effettivamente le cose possono migliorare nettamente: il formato jpeg Joint Photographic Experts Group è un formato immagine standard compresso che non usa tutte le informazioni che la fotocamera può registrare; il formato Raw al contrario è assimilabile ad un negativo digitale, un file immagine così come viene letto dal sensore ed al quale non è stato applicato il demosaicing. Il file Raw sfrutta tutti i 10, 12 o 14 bit che permette la fotocamera al contrario del formato jpeg, che viene compresso ad 8 bit. Loperazione di demosaicing può essere fatta a posteriori attraverso software specifici come Adobe Camera Raw®, LightRoom®, Aperture®, AppleOne®, FreeRaw, ecc. e le informazioni riguardanti il bilanciamento del bianco e di conseguenza colori e saturazione, livello di contrasto, luminosità sono disponibili alla conversione sempre attraverso lalgoritmo migliore. Da una parte perché questi software vengono continuamente aggiornati, dallaltra perché un computer può permettersi una potenza di elaborazione nettamente superiore al convertitore Raw presente allinterno di una fotocamera. Per assurdo, la stessa foto potrebbe migliorare col tempo!! Per concludere, basti riflettere sul fatto che apportare modifiche ad unimmagine a 12 bit è certamente meno degradante che farlo su una a 8 bit.

Vietata la copia e la distribuzione (anche parziale) senza la previa autorizzazione di Hardware Upgrade S.r.l

Per maggiori informazioni : http://www.hwupgrade.it/sito/legale/

Copyright 1997 - 2026 Hardware Upgrade S.r.l